P+F洗车机传感器华为的CC架构,可以做到软件可升级、硬件可更换、传感器可拓展。它将车辆分为三大部分:驾驶、座舱和整车控制,并推出了三大平台:MDC智能驾驶平台、CDC智能座舱平台和VDC整车控制平台。华为通过提供芯片+操作系统,将上述三大平台的每一个平台都打造成一个生态系统。

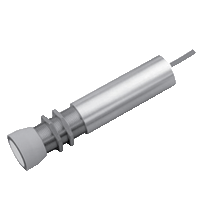

(P+F 超声波传感器 UC4000-30GM-IUR2-V15)

参数化接口,用于通过服务程序 ULTRA 3000 根据具体应用调整传感器设置,模拟电流和电压输出,同步选项,可调声功率和灵敏度,温度补偿

感应范围 : 200 ... 4000 mm 调整范围 : 240 ... 4000 mm 死区 : 0 ... 200 mm 标准目标板 : 100 mm x 100 mm 换能器频率 : 大约 85 kHz 响应延迟 : 最短 145 ms

440 ms,出厂设置 绿色 LED : 常亮:通电

闪烁:待机模式或程序功能检测到物体 黄色 LED 1 : 常亮:物体在评估范围内

闪烁:程序功能 黄色 LED 2 : 常亮:在检测范围内有物体时

闪烁:程序功能 红色 LED : 常亮:温度/编程插头未连接

闪烁:发生故障或编程功能没有检测到物体 温度/示教连接器 : 温度补偿 , 评估范围编程 , 输出功能设置 工作电压 : 10 ... 30 V DC ,纹波 10 %SS 功耗 : ≤ 900 mW 可用前的时间延迟 : ≤ 500 ms 接口类型 : RS 232, 9600 Bit/s , 无奇偶校验,8 个数据位,1 个停止位 同步 : 双向

0 电平 -UB...+1 V

1 电平:+4 V...+UB

输入阻抗:> 12 KOhm

同步脉冲:≥ 100 µs,同步脉冲间歇时间:≥ 2 ms 同步频率 : 输出类型 : 1 路电流输出 4 ...20 mA

1 路电压输出 0 ...10 V 分辨率 : 评估范围 [mm]/4000,但是 ≥ 0,35 mm 特性曲线的偏差 : ≤ 0,2 % 满量程值 重复精度 : ≤ 0,1 % 满量程值 负载阻抗 : 电流输出: ≤ 500 Ohm

电压输出: ≥ 1000 Ohm 温度影响 : ≤ 2 满量程值的 %(带温度补偿)

≤ 0.2%/K(无温度补偿) 符合标准 : UL 认证 : cULus 认证,一般用途 CSA 认证 : 通过 cCSAus 认证,一般用途 CCC 认证 : 额定电压 ≤ 36 V 时,产品不需要 CCC 认证/标记 环境温度 : -25 ... 70 °C (-13 ... 158 °F) 存储温度 : -40 ... 85 °C (-40 ... 185 °F) 连接类型 : 连接器插头 M12 x 1 , 5 针 防护等级 : IP65 材料 : 质量 : 210 g 输出 : 评估极限 A1: 500 mm

评估极限 A2: 4000 mm

上升斜坡

济南洗车机传感器在日常使用的过程中,“色彩”应该是广大用户最关注的点。Redmi Note 11T Pro+的这块LCD屏幕经过充分调校,它的色准数据为ΔE≈0.44,JNCD≈0.36,这样的色彩校准水平已经达到了目前的一流水准。另外,Redmi Note 11T Pro+还为用户提供了色温自动调节功能,通过硬件级色温传感器,屏幕色温可以跟随环境色温自动调节,做到任何场景下舒适显示。

资料洗车机传感器第三代G-SYNC:优质电竞显示器的象征2018年,NVIDIA推出了第三代G-SYNC,这次最大的改变是升级到第二代硬件模块,新模块不仅升级了新的FPGA,增加输出带宽,模块内存容量变成3GB,视频输出接口升级到HDMI2.0和DP1.4,并且增加了对光线传感器的支持。

P+F洗车机传感器这种热气除霜本质是「预除薄霜」,不需要增加很多硬件成本,但需要更精准的传感器数据,和更复杂和智能的电控程序才能做到。在化霜过程中,空调内机蒸发器一直保持制热模式,房间内温度偏差可低至1.5℃,除霜舒适度体验比较好。

济南洗车机传感器人的身体有视觉、听觉、嗅觉、味觉、触觉五大感知系统,我们所接收的 80%的信息都来自 于眼睛,且人的头部占据了四大感官系统。为追求更自然的交互,继 6DoF 之后,面部追踪、 眼球追踪等是众多 VR 厂商都在极力研发与使用的技术。面部追踪与眼球追踪的概念由来已 久,但在现阶段将多项追踪技术集成到一个 VR 头显中,还存在一定的难点,需要更多的组 件,也意味着额外的成本,依赖软硬件的共同进步。 眼球追踪又称注视点追踪,是利用传感器捕获、提取眼球特征信息,测量眼睛的运动情况, 估计视线方向或眼睛注视点位臵的技术。眼动追踪被认为可以实现新的输入方式,且可以提 供注视点渲染。相较于面部追踪,眼球追踪技术还远未成熟,比如人与人之间的生物学差异 大,不同国家不同人群的瞳距、散光等不同,很难全面覆盖人群。

资料洗车机传感器感知:SLAM 持续渗透, 品牌开发平台支持SLAM 助力开发应用。SLAM 即同步定位与地 图构建技术, 主要包含感知/定位/建图三个过程, 其系统一般分为五个模块:传感器数据/前 端视觉里程计/后端/建图/回环检测, 工作流程大概为: 传感器读取数据后,视觉里程计估 计两个时刻的相对运动(Ego-motion),后端处理视觉里程计估计结果的累积误差,建图 则根据前 端与后 端得到 的运动 轨迹来 建立三 维地图 ,回环检 测考虑 了同一 场景不 同时刻 的 图像,提供了空间上约束来消除累积误差, 主要分为激光SLAM 和视觉SLAM 两大类。相 对于基于硬件, 基于视觉的感知跟踪不需要预存场景, 跟踪范围大, 精度能够持续提 升,HoloLens及Magic Leap。19 年以来, SLAM 渗透率提高, 上市新品中有三款支持SLAM, 并且, 品牌推出AR 开发平台上配置支持SLAM: 16年EasyAR SDK 2.0 、腾讯AR平台QAR、 OPPO 18 年ARunit、 Wikitude、Kudan 等,助力 SLAM 感知技术的开发应用。

SLAM是AR必备的核心技术,为了实现虚拟与现实的融合,在任意元素的定位和虚拟延展上都需要SLAM进行定位。目前苹果(ARKit)、华为(AR Engine)、Google(ARCore)推出的AR SDK均采用的是单目视觉+IMU融合定位的技术路线。目前也出现了各小公司在关键细分领域如传感器、软件、算法、硬件等方向的分化。各大巨头在不断投入研发之外,也在作出布局和收购的动作。

SLAM的应用由于需要接收外部信息和精细化处理的需求,这使得SLAM对传感器的质量极其依赖。虽然该领域由巨头分别逐步的进行推进,但目前SLAM的产品和硬件总体仍体现呈高度差异化。同时,移动端硬件的算力还不够,这使得SLAM的丰满还需期待。

激光雷达兼具测距远、角度分辨率优、受环境光照影响小的特点,且无需深度学习算法,可直接获得物体的距离和方位信息,与其他传感器互补结合使用可帮助感知系统减小探测误差,因而被大多数整车厂、Tier 1 认为是L3级及以上自动驾驶必备的传感器。自2020年年底开始,各大车企陆续宣布激光雷达装车,2022年,蔚来ET7、理想L9、阿维塔11、智己L7、小鹏G9、极狐α-SHI等多款新车型上市,使激光雷达正式步入量产元年。根据Yole对不同自动驾驶等级对传感器需求的分析,L3级自动驾驶需搭载1个激光雷达,L4级搭载2-3个,L5级搭载4-6个。国海证券指出,2022年新车型普遍预埋L4级自动驾驶硬件,从选装到标配,引发硬件军备竞赛,激光雷达作为高级别自动驾驶主流方案核心传感器,正在迎来量产爆发期,与主机厂深度合作的公司在市场竞争中将占据优势。

人的身体有视觉、听觉、嗅觉、味觉、触觉五大感知系统,我们所接收的 80%的信息都来自 于眼睛,且人的头部占据了四大感官系统。为追求更自然的交互,继 6DoF 之后,面部追踪、 眼球追踪等是众多 VR 厂商都在极力研发与使用的技术。面部追踪与眼球追踪的概念由来已 久,但在现阶段将多项追踪技术集成到一个 VR 头显中,还存在一定的难点,需要更多的组 件,也意味着额外的成本,依赖软硬件的共同进步。 眼球追踪又称注视点追踪,是利用传感器捕获、提取眼球特征信息,测量眼睛的运动情况, 估计视线方向或眼睛注视点位臵的技术。眼动追踪被认为可以实现新的输入方式,且可以提 供注视点渲染。相较于面部追踪,眼球追踪技术还远未成熟,比如人与人之间的生物学差异 大,不同国家不同人群的瞳距、散光等不同,很难全面覆盖人群。